Screenshot

(가상의 제안서) K-콘텐츠 몰입 및 상호작용 증진 시스템 (K-C-I) 개발

본 제안서는 국내의 HCI 연구자들이 발표한 최신 연구결과들을 기반으로, (2025년 9월15일에서 2025년 9월27일 사이에 수집) K-콘텐츠에 대한 사용자의 경험의 폭과 깊이를 극대화하기 위한 시스템 ‘K-C-I (K-Content Immersion & Interaction)’를 구축하는 것을 목표로 합니다. K-C-I 시스템은 사용자가 K-드라마, K-팝 등의 콘텐츠를 단순히 소비하는 것을 넘어, 콘텐츠 속 감정과 상황을 온몸으로 체험하고, 관련 정보를 심층적으로 습득하며, 커뮤니티에서 적극적으로 상호작용하도록 돕는 통합형 서비스입니다.

–

통합 응용 서비스 시나리오

–

–

이 시스템은 크게 세 가지 축으로 구성됩니다.

- 몰입형 체험 극대화:

- 사용자가 K-드라마를 시청할 때, 감동적이거나 긴장감 있는 장면에 맞춰 다양한 물리적 효과(예: 좌석 흔들림, VR 모션 피드백)가 제공되어 놀람과 각성과 같은 감정 반응을 극대화합니다.

- VR 환경에서 K-팝 댄스 커버나 드라마 속 상황을 체험할 때, 제한된 실제 공간에서도 넓은 가상 환경을 자유롭게 걸어다니는 듯한 보행 감각과 시각적 몰입감을 일치시켜 현실감을 높입니다.

- 개인 맞춤형 콘텐츠 및 정보 제공:

- 사용자는 대화형 AI 에이전트와 상호작용하며 콘텐츠에 대한 심층적인 대화를 나눕니다. 이 에이전트는 사용자의 개인 정보 공개(self-disclosure) 성향을 높일 수 있도록 인간적인 외형(높은 인격 부여)과 공감 표현을 조성하여 친밀감을 형성합니다.

- 에이전트는 사용자의 질문이나 감정 상태에 맞춰, 다양한 장르와 감성을 담은 음악(예: K-팝 OST, 댄스 음악 등)을 멀티모달(음성, 이미지 포함) 대화 방식으로 추천하고, 복잡한 음악 정보를 자동으로 생성하여 제공합니다.

- 피아노 연주 동작이나 손가락 움직임(핑거링) 데이터셋을 쉽게 수집하고 주석화하는 도구를 활용하여, K-팝 연습을 위한 학습 자료를 정밀하게 분석하고 개인 맞춤형 피드백을 제공합니다.

- 커뮤니티 및 소셜 상호작용 지원:

- 사용자는 메신저 앱(카카오톡 등)을 통해 K-콘텐츠 관련 디지털 선물을 주고받습니다. 이 때, 한국의 문화적 특징을 반영한 서비스 디자인을 통해 사회적 관계를 강화하도록 돕습니다.

- K-콘텐츠 제작 과정에서 나온 창의적 의사결정 과정(디자이너의 아이디어, 결정 이유 등)을 투명하게 기록하고 공유하여, 팬들이 콘텐츠 비하인드 스토리를 더 잘 이해하고 콘텐츠에 대한 심층적인 논의를 이어갈 수 있도록 지원합니다.

–

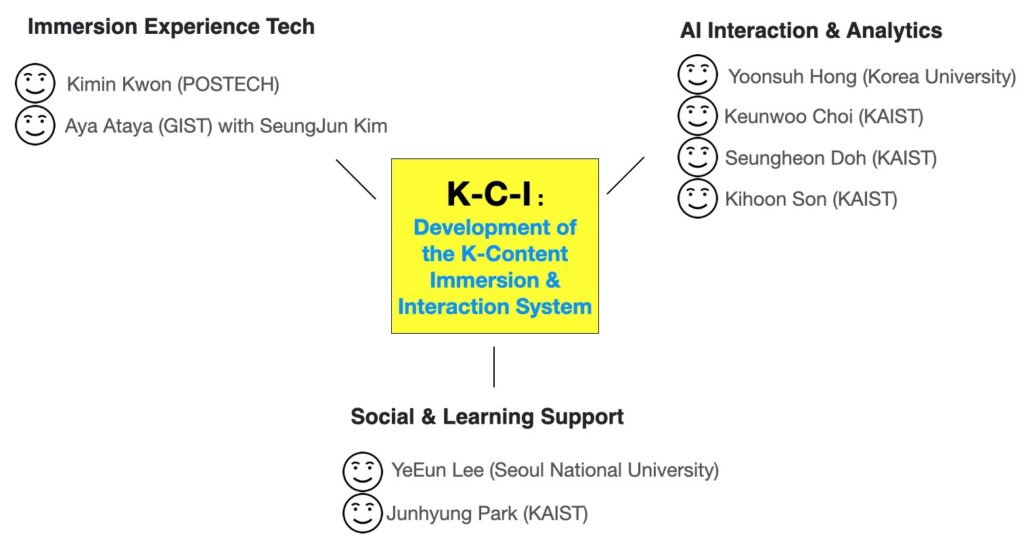

응용 서비스 개발을 위한 세부 연구팀 구성 및 과제 제안

K-C-I 시스템 개발을 위해 다음과 같이 세 개의 핵심 연구팀을 제안하며, 각 팀은 제안된 통합 시나리오의 핵심 요소 기술을 개발합니다.

–

–

팀 A: 실감형 콘텐츠 경험 기술 연구팀 (Immersion Experience Tech)

이 팀은 K-콘텐츠를 시청하거나 체험할 때 사용자의 신체적, 감정적 몰입도를 최고 수준으로 끌어올리는 하드웨어 및 소프트웨어 기술을 개발합니다.

과제 1: 4D 모션 효과 기반의 감정 반응 유도 기술 최적화

4D 영화의 ‘싱글 롤 모션’이 심박수와 피부 전도도를 유의미하게 증가시켜 사용자의 반응과 각성을 증대시킨다는 특성을 활용하여, K-드라마나 K-팝 콘텐츠에 포함된 감정(기쁨, 슬픔, 긴장 등)에 최적화된 모션 효과(움직임, 바람, 향기 등)의 조합을 개발합니다. 관객의 공감 능력이나 회전 각도에 따른 감정 반응 차이를 고려하여 맞춤형 4D 체험 모듈을 구현합니다.

팀원 구성

- Kimin Kwon(POSTECH)

- Kimin Kwon(POSTECH)은 이전 연구(4D 영화 감정 DB, 감정 요소 분류, 싱글 롤 모션 효과 분석)들에서의 경험을 바탕으로, K-콘텐츠의 정서적 요소(예: 드라마의 하이라이트, K-팝 안무의 주요 파트)와 모션 효과 간의 상관관계를 체계적으로 분석하고 최적의 4D 디자인 파라미터(모션, 자극 등)를 도출하는 역할을 수행합니다.

근거 논문

- (논문 #1) Investigating affective and emotional responses to motion in 4D movies (https://www.sciencedirect.com/science/article/pii/S0169814125001167)

과제 2: VR 환경에서의 몰입감 증진을 위한 보행 감각 일치 시스템 개발

VR 댄스 커버나 드라마 속 가상 체험 시, ReD Shoes를 활용하여 착용자의 발에 직접 촉각 피드백을 제공하여, 제한된 실제 공간에서의 보행과 가상 환경 내 이동 인지 간의 불일치(멀미, 불편함 등)를 최소화합니다. 이를 위한 최적의 파라미터를 발굴하고, 안전하면서도 현실적인 인식 결과를 제공합니다.

팀원 구성

- Aya Ataya(GIST) (with SeungJun Kim)

- Aya Ataya(GIST) (with SeungJun Kim)는 이전 연구(VR 환경에서의 회전 조작 및 방향 재설정(RDW) 기술, 주의 집중 작업 도입을 통한 회전 조작 인지 감소 연구)에서의 경험을 활용하여, K-콘텐츠 VR 체험 환경에서 사용자가 가상 공간을 자유롭게 탐험하는 동안 안전성 및 몰입감을 저해하지 않는 최적의 보행 조작 기법과 촉각 피드백 메커니즘을 설계 및 구현하는 책임을 맡습니다.

근거 논문

- (논문#2) ReD shoes: actuated footwear for multisensory redirected walking in virtual reality (https://link.springer.com/article/10.1007/s10055-025-01234-w)

팀 B: AI 기반 맞춤형 상호작용 및 분석 연구팀 (AI Interaction & Analytics)

이 팀은 사용자와 K-콘텐츠 관련 대화를 나누고, 콘텐츠를 정밀하게 분석하여 맞춤형 정보 및 추천을 제공하는 AI 모델 및 인터페이스를 개발합니다.

과제 3: 감정적 몰입 증진을 위한 인격 부여 AI 에이전트 개발

사용자가 K-콘텐츠에 대한 개인적인 감상, 질문, 또는 경험 등을 에이전트에게 편안하게 털어놓도록 유도하기 위해 높은 인간적인 외형과 공감(인지적/정서적) 표현 방식을 결합한 대화형 AI를 개발합니다. 에이전트 디자인이 사용자의 자발적 정보 공유(self-disclosure) 증진 및 긍정적 평가에 미치는 영향을 분석하여 최적의 에이전트 페르소나를 구축합니다.

팀원 구성

- Yoonsuh Hong(Korea University)

- Yoonsuh Hong(Korea University)는 이전 연구(AI 공감, 인격 부여 및 사용자 상호작용, 외로움과 따뜻함 선호 분석)에서의 경험을 바탕으로, K-콘텐츠 사용자 커뮤니티 내 소외된 사용자들의 심리적 안정감을 높이는 대화 전략과, 신뢰 기반의 상호작용을 촉진하기 위한 에이전트의 시각적, 언어적 공감 표현 기법을 설계하고 검증하는 역할을 담당합니다.

근거 논문

- (논문#3) How anthropomorphism impacts users’ self-disclosure and evaluation of empathetic conversational agents (https://academic.oup.com/iwc/advance-article-abstract/doi/10.1093/iwc/iwaf042/8255974)

과제 4: 멀티모달 대화형 K-팝/OST 음악 추천 시스템 개발

K-드라마의 상황, K-팝 아티스트의 컨셉 이미지, 사용자 감정 상태(음성 인식 등)를 복합적으로 고려하여 음악을 추천하는 대화형 AI 시스템을 개발합니다. TalkPlayData 2의 합성 데이터 생성 파이프라인을 활용하여, 음악 청취자 및 추천 시스템 역할을 하는 LLM 에이전트들을 통해 K-콘텐츠 맥락에 맞는 멀티모달 대화 데이터셋을 구축합니다. 이를 통해 사용자 맞춤형 추천 알고리즘의 정확도를 높이고 자연스러운 대화가 이루어지게 합니다.

팀원 구성

- Keunwoo Choi(KAIST) & Seungheon Doh(KAIST)

- Keunwoo Choi(KAIST)와 Seungheon Doh(KAIST)은 이전 연구(TalkPlay 멀티모달 추천 시스템, 음악 캡셔닝 시스템)에서의 경험을 바탕으로, K-콘텐츠와 관련된 다양한 음악 정보(오디오, 가사, 메타데이터, 감성 태그 등)를 통합하여 표현하는 멀티모달 임베딩 기술을 개발합니다. 또한, LLM 에이전트를 활용하여 K-콘텐츠 팬덤 문화와 관련성이 높은 대화 시나리오 기반의 합성 데이터셋을 구축하고, 시스템의 추천 성능과 사용자 만족도를 평가하는 작업을 수행합니다.

근거 논문

- (논문#4) TalkPlayData 2: An Agentic Synthetic Data Pipeline for Multimodal Conversational Music Recommendation (https://arxiv.org/abs/2509.09685)

과제 5: 창의적 제작 의사결정 기록을 통한 콘텐츠 투명성 및 팬 참여 증진

K-콘텐츠(예: 웹툰, 뮤직비디오, 상품 디자인) 제작 과정에 CLEAR 프레임워크 기반의 ClearFairy AI 어시스턴트를 도입합니다. 디자이너와 제작진의 의사결정 과정과 근거를 실시간으로 기록하고, 누락된 설명을 추론 및 질문을 통해 보충합니다. 이렇게 확보된 투명한 의사결정 데이터를 팬 커뮤니티에 공유하여, 콘텐츠 제작 비하인드를 심층적으로 제공하고 팬들의 아이디어/피드백을 반영하는 소통 창구로 활용합니다.

팀원 구성

- Kihoon Son(KAIST)

- Kihoon Son(KAIST)는 이전 연구(AI Intent Alignment, Expandora, Tacit Knowledge, GenQuery 등)를 통해 쌓은 창의적 작업 과정 분석 및 AI 기반 지원 시스템 개발 경험을 바탕으로, K-콘텐츠 제작자들이 내리는 창의적 결정의 논리적 구조를 체계적으로 분석하고, 제작진의 암묵적 지식(Tacit Knowledge)과 의도를 명확하게 캡처하여 팬들에게 전달할 수 있는 ClearFairy 모듈을 설계하는 역할을 수행합니다.

근거 논문

- (논문#5) ClearFairy: Capturing Creative Workflows through Decision Structuring, In-Situ Questioning, and Rationale Inference (https://arxiv.org/abs/2509.14537)

팀 C: 소셜 및 학습 연동 지원 연구팀 (Social & Learning Support)

이 팀은 K-콘텐츠의 사회적 상호작용 및 학습(예: 춤, 언어)을 돕는 기능과 플랫폼을 연구하여 사용자 경험을 확장합니다.

과제 6: 문화 맞춤형 디지털 선물 서비스 디자인 및 구현

K-콘텐츠 팬덤 커뮤니티에 메신저 기반의 디지털 선물 기능을 핵심 소셜 기능으로 추가합니다. 특히 한국 특유의 선물 교환 문화를 반영하여 카카오톡 형태의 Channel-Oriented Gifting Cycle 모델을 적용합니다. 단순한 상품 교환을 넘어, K-콘텐츠 관련 스티커, 테마 선물, 소셜 펀딩 등을 통해 팬덤 간 유대와 소속감을 강화하도록 디자인합니다.

팀원 구성

- YeEun Lee(Seoul National University)

- YeEun Lee(Seoul National University)은 이전 연구(동아시아 메신저 기반 디지털 선물 문화 비교 분석, 일기 기반 음악 생성 시스템)에서의 경험을 바탕으로, K-콘텐츠 팬덤의 소셜 상호작용 패턴을 분석하고, 한국 및 해외 팬들의 문화적 기대치에 부합하는 디지털 선물 서비스의 사용자 경험(UX) 및 인터페이스를 설계하는 역할을 맡습니다.

근거 논문

- (논문#6) Understanding Digital Gifting Through Messengers Across Cultures: A Comparative Study of University Students in South Korea, China, and Japan (https://arxiv.org/abs/2509.16932)

과제 7: K-팝 연주/댄스 커버 학습을 위한 멀티모달 데이터 구축 도구 연동

K-팝 댄스를 커버하거나 댄스곡을 연주하려는 학습자들을 위해 PiaRec(오디오, 비디오, 메타데이터 수집) 및 ASDF(손가락 움직임 주석화) 웹 툴킷을 확장하여, 멀티모달 학습 데이터(예: 댄스 동작 비디오, 안무별 MIDI/음악 데이터, 전문가 핑거링/동작 주석)를 효율적으로 수집하고 분석하는 모듈을 개발합니다. 이를 통해 AI 기반 자동 피드백 및 맞춤형 레슨 콘텐츠 제작의 기반을 마련합니다.

팀원 구성

- Junhyung Park(KAIST)

- Junhyung Park(KAIST)은 이전 연구(PianoVAM 데이터셋, 피아노 웹 툴킷 개발)에서의 경험을 바탕으로, 피아노 연주뿐 아니라 K-팝 댄스 커버 영상에서 안무가의 동작, 손동작 등을 정밀하게 캡처하고 주석을 추가할 수 있는 데이터 수집 및 주석화 파이프라인을 확장 및 최적화하는 연구를 수행합니다. 이를 통해 학습자에게 객관적인 연주/동작 분석 정보를 제공할 수 있게 됩니다.

근거 논문

- (논문#7) Two Web Toolkits for Multimodal Piano Performance Dataset Acquisition and Fingering Annotation (https://arxiv.org/abs/2509.15222)

–

한국의 신진 연구자들이 여는 K-콘텐츠의 미래

이번 가상 제안에 포함된 연구자들은 기술 개발을 넘어 K-콘텐츠 경험을 완전히 새롭게 바꿀 열쇠를 쥔 연구자들입니다. (실제로 본인들이 이에 동의할 지는 알 수 없지만요. :-))

- Kimin Kwon(POSTECH) 은 드라마와 K-팝 속 감정 요소를 4D 모션 효과와 정교하게 연결하며, 우리가 스크린 속 이야기를 심장으로 느끼게 만드는 역할을 합니다.

- Aya Ataya(GIST) (with SeungJun Kim) 은 VR 속 보행감각과 촉각 피드백을 연구해, 사용자가 넓은 공간에서 자유롭게 돌아다니는 경험을 할 수 있게 합니다.

- Yoonsuh Hong(Korea Univ.) 은 따뜻하고 인간적인 AI 에이전트를 만들어, 팬들이 콘텐츠에 대한 감정과 생각을 편하게 털어놓을 수 있는 친구 같은 존재를 제공합니다.

- Keunwoo Choi(KAIST) 와 Seungheon Doh(KAIST) 은 음악과 대화를 결합한 추천 시스템을 통해, 사용자의 기분과 콘텐츠 맥락에 맞는 K-팝 음악을 선물합니다.

- Kihoon Son(KAIST) 은 제작자의 창의적 결정을 기록하고 공유하여, 팬들이 단순 소비자가 아니라 제작 과정에 참여하는 동반자가 되도록 합니다.

- YeEun Lee(SNU) 는 한국 특유의 디지털 선물 문화를 반영해, 팬덤 사이의 교류를 더 따뜻하고 의미 있게 만들어 줍니다.

- Junhyung Park(KAIST) 은 K-팝 연습자들이 춤과 음악을 더 잘 배우도록 멀티모달 데이터 툴을 확장해, 개인 맞춤형 학습을 가능하게 합니다.

앞으로 이런 연구들이 실제로 현실화된다면, 한국의 신진 연구자들은 단순히 논문에 머무르지 않고, K-콘텐츠를 세계 무대에서 한층 더 특별하게 만드는 주인공이 될 것입니다. 팬들은 더 깊이 몰입하고, 제작자는 더 투명하게 소통하며, 모두가 새로운 방식으로 K-콘텐츠를 즐기게 되겠지요.