*** 위의 그림은 ChatGPT로 생성한 것입니다.

최근 인공지능 분야를 뜨겁게 달구고 있는 모델들 중의 하나는 llama3입니다.

준수한 성능을 보이면서도 오픈소스이며, 비교적 작은 규모의 컴퓨팅 환경에서도 구동시킬 수 있다는 것이 llama3의 가장 중요한 특징입니다.

그렇다면, llama 모델은 어떻게 변화해 왔을까요?

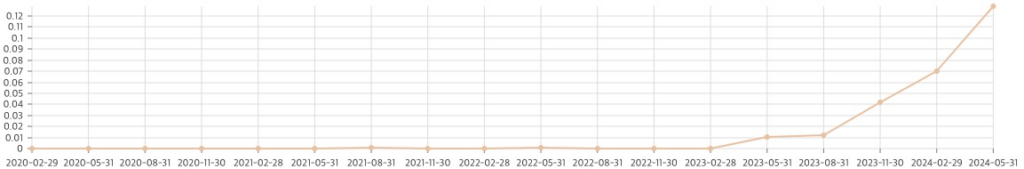

위의 그림은 2020년부터 최근까지 huggingface의 모델 정보들에서 llama가 언급된 정도의 트렌드를 보여줍니다. 역시 뜨거운 관심이 집중되고 있음이 수치 상으로도 드러나네요.

인포리언스가 개발한 이슈분석 시스템 에서는 huggingface의 모델 정보들에서 언급된 llama에 대해 다음과 같이 정리한 결과를 내놓았습니다.

그런데, 흥미롭게도, 2022년 10월에는 언어모델이 아니라 동물 llama에 대해 언급했네요? ^^

++++++++++++++++++++++++++++++++++++++++++++++++++++++++++++++++++++++++++++

2022년 10월 문서에서는 alpaca, guanaco, llama, vicuna, camello 및 vicuna 같은 다양한 종류의 llama에 대한 이미지와 관련 정보를 제공하며, 이들 간의 관계를 설명하고 있습니다. 여기서는 Llama와 관련된 기본적인 정보와 분류에 초점을 맞추고 있어 복잡한 인공지능 기술보다는 동물과의 연관성에 주목하고 있습니다.

2023년 4월에는 “Low-Rank-Adaption(LoRA)” 기법인 LLAMA 6B 모델에 대해 언급하며, Stanford Alpaca instruction dataset을 사용한 fine-tune 작업에 대해 설명합니다. 여기서 Llama는 13B와 같은 대형 언어 모델을 지칭하며, 최신 transformers 버전을 필요로 하는 것을 언급합니다.

2023년 8월 문서에서는 “LLaMa” 기반의 13b 파라미터를 사용하여 fine-tuned된 Hermes 모델에 대해 다룹니다. 이 모델은 LLama-1과 같은 데이터셋을 사용하며, Jon Durbin의 Airoboros 7B GPT4 원본 모델 카드를 바탕으로 합니다.

2023년 10월의 내용은 Photolens의 “Llama-2-7b-langchain-chat” 모델을 GGUF 포맷으로 변환한 것에 대해 언급합니다. 이는 LLaMA-2 라이브러리와 HuggingFace Transformers를 기반으로 이루어졌으며, 원본 Llama-1 모델의 라이센스 및 사용 제한 사항을 따릅니다.

2024년 1월과 4월의 문서에서는 포르투갈어 언어 모델인 “Bode”와 Meta-LLama 3의 고급 구성 및 GGUF 포맷 지원 등에 대한 정보를 제공합니다. 이는 Llama 2를 바탕으로 개발된 것으로, 여기서도 해당 모델들은 다양한 언어와 포맷을 지원하기 위한 연구 및 개발의 일환으로 볼 수 있습니다.

이 문서들을 통해 보이는 공통적인 목적은 언어 모델(Llama)의 기술적 발전과 다양한 언어 및 데이터셋에 대한 적용 가능성을 모색하는 것입니다. 연구자들과 개발자들은 Llama 모델을 기반으로 하는 다양한 프로젝트를 통해 인공지능 언어 모델의 한계를 넓히고, 더욱 다양한 언어와 상황에서의 응용 가능성을 탐구하고 있습니다.

각 문서의 Source URL 리스트는 아래와 같습니다:

2022-10

- [https://huggingface.co/osanseviero/llama-alpaca-guanaco-vicuna](https://huggingface.co/osanseviero/llama-alpaca-guanaco-vicuna)

- [https://huggingface.co/osanseviero/llamas-alpacas-camellos-platzi](https://huggingface.co/osanseviero/llamas-alpacas-camellos-platzi)

2023-4

- [https://huggingface.co/Eterna2/alpaca-lora-7b](https://huggingface.co/Eterna2/alpaca-lora-7b)

- [https://huggingface.co/digitous/13B-HyperMantis](https://huggingface.co/digitous/13B-HyperMantis)

- [https://huggingface.co/22h/cabrita-lora-v0-1](https://huggingface.co/22h/cabrita-lora-v0-1)

- [https://huggingface.co/teknium/Base-GPT4-x-Alpaca-Roleplay-Lora](https://huggingface.co/teknium/Base-GPT4-x-Alpaca-Roleplay-Lora)

- [https://huggingface.co/JosephusCheung/Guanaco](https://huggingface.co/JosephusCheung/Guanaco)

- [https://huggingface.co/elinas/llama-30b-int4](https://huggingface.co/elinas/llama-30b-int4)

2023-8

- [https://huggingface.co/NousResearch/Nous-Hermes-Llama2-70b](https://huggingface.co/NousResearch/Nous-Hermes-Llama2-70b)

- [https://huggingface.co/NousResearch/Nous-Hermes-Llama2-13b](https://huggingface.co/NousResearch/Nous-Hermes-Llama2-13b)

- [https://huggingface.co/digitalpipelines/llama2_13b_chat_uncensored-GPTQ](https://huggingface.co/digitalpipelines/llama2_13b_chat_uncensored-GPTQ)

- [https://huggingface.co/digitalpipelines/llama2_13b_chat_uncensored-GGML](https://huggingface.co/digitalpipelines/llama2_13b_chat_uncensored-GGML)

- [https://huggingface.co/IlyaGusev/saiga_13b_lora](https://huggingface.co/IlyaGusev/saiga_13b_lora)

- [https://huggingface.co/TheBloke/airoboros-7b-gpt4-fp16](https://huggingface.co/TheBloke/airoboros-7b-gpt4-fp16)

2023-10

- [https://huggingface.co/YanaS/llama-2-7b-langchain-chat-GGUF](https://huggingface.co/YanaS/llama-2-7b-langchain-chat-GGUF)

- [https://huggingface.co/LoneStriker/Yarn-Llama-2-70b-32k-4.0bpw-h6-exl2](https://huggingface.co/LoneStriker/Yarn-Llama-2-70b-32k-4.0bpw-h6-exl2)

- [https://huggingface.co/NousResearch/Nous-Hermes-llama-2-7b](https://huggingface.co/NousResearch/Nous-Hermes-llama-2-7b)

- [https://huggingface.co/Riiid/sheep-duck-llama-2](https://huggingface.co/Riiid/sheep-duck-llama-2)

- [https://huggingface.co/microsoft/llava-med-7b-delta](https://huggingface.co/microsoft/llava-med-7b-delta)

- [https://huggingface.co/mychen76/mistral7b_ocr_to_json_v1](https://huggingface.co/mychen76/mistral7b_ocr_to_json_v1)

2024-1

- [https://huggingface.co/recogna-nlp/bode-13b-alpaca-pt-br-gguf](https://huggingface.co/recogna-nlp/bode-13b-alpaca-pt-br-gguf)

- [https://huggingface.co/llava-hf/llava-1.5-13b-hf](https://huggingface.co/llava-hf/llava-1.5-13b-hf)

- [https://huggingface.co/mlx-community/Llama-2-7b-mlx](https://huggingface.co/mlx-community/Llama-2-7b-mlx)

- [https://huggingface.co/stanford-oval/Llama-2-7b-WikiChat](https://huggingface.co/stanford-oval/Llama-2-7b-WikiChat)

- [https://huggingface.co/CompendiumLabs/bge-large-zh-v1.5-gguf](https://huggingface.co/CompendiumLabs/bge-large-zh-v1.5-gguf)

- [https://huggingface.co/swap-uniba/LLaMAntino-2-7b-hf-ITA](https://huggingface.co/swap-uniba/LLaMAntino-2-7b-hf-ITA)

2024-4

- [https://huggingface.co/bartowski/Meta-Llama-3-8B-Instruct-GGUF](https://huggingface.co/bartowski/Meta-Llama-3-8B-Instruct-GGUF)

- [https://huggingface.co/lucianosb/boto-7B-GGUF](https://huggingface.co/lucianosb/boto-7B-GGUF)

- [https://huggingface.co/CISCai/Cerebrum-1.0-8x7b-SOTA-GGUF](https://huggingface.co/CISCai/Cerebrum-1.0-8x7b-SOTA-GGUF)

- [https://huggingface.co/MaziyarPanahi/Llama-3-11B-Instruct-v0.1](https://huggingface.co/MaziyarPanahi/Llama-3-11B-Instruct-v0.1)

- [https://huggingface.co/IlyaGusev/saiga_7b_lora](https://huggingface.co/IlyaGusev/saiga_7b_lora)

- [https://huggingface.co/bartowski/Meta-Llama-3-8B-Instruct-special-tokens-exl2](https://huggingface.co/bartowski/Meta-Llama-3-8B-Instruct-special-tokens-exl2)